Vorwort

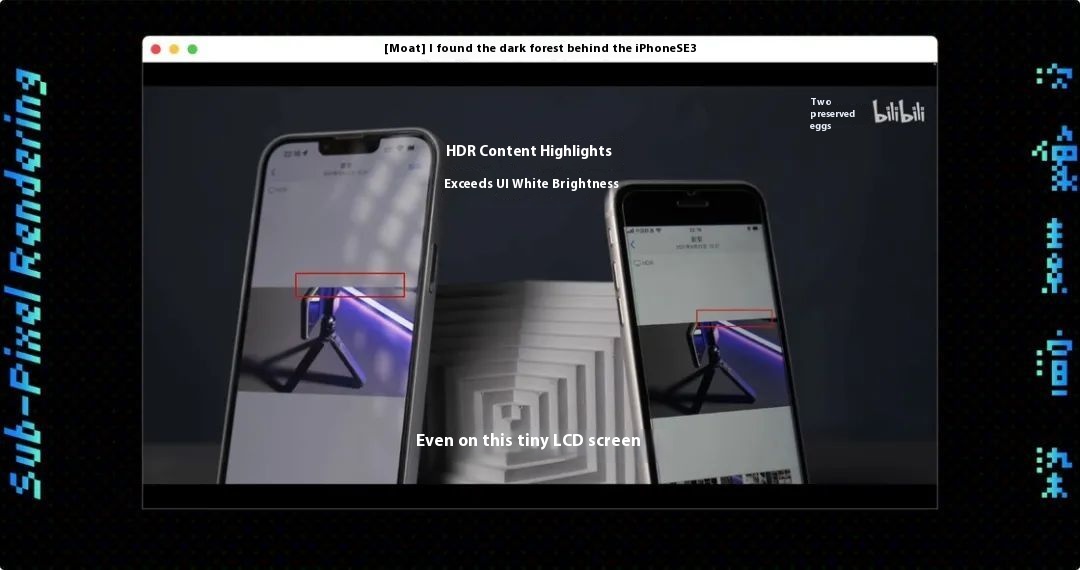

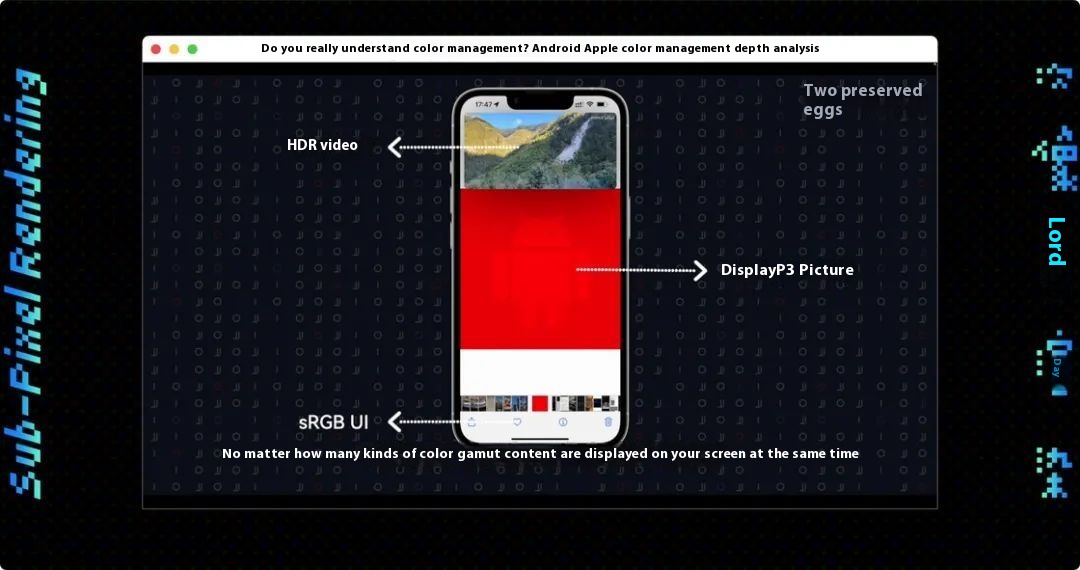

Ich möchte Ihnen einige der besseren Anzeigeeffekte von Apple-Produkten vorstellen: zum Beispiel das Farbmanagement, das im richtigen Farbraum entsprechend der Bild- oder Videokonfigurationsdatei rendern kann; und Local HDR, das die hohe Helligkeit von OLED oder Mini-LED nutzen kann, um die Helligkeit von Bildern oder Videos so weit wie möglich wiederherzustellen.

Aber ich weiß nicht, ob Ihnen ein Problem aufgefallen ist: Diese beiden Funktionen tun im Grunde dasselbe: Sie erstellen einen Container mit ausreichender Helligkeit und Farbe, übertragen den gesamten Inhalt hinein und konvertieren ihn anschließend in ein vom Bildschirm akzeptiertes Datenformat. Die Pixel des Bildschirms akzeptieren nur ein Datenformat, nämlich das RGB-Signal und die aktuelle Helligkeit. Dieser Vorgang wird vom System ohne Hardwarebeteiligung ausgeführt. Ich würde es die Kunst der Pixelverarbeitung nennen.

Das Thema, das wir heute behandeln werden, ist jedoch grundlegender. Denn wir alle wissen, dass für jedes Pixel im Bildinhalt mehrere RGB-Pixel gemischt und auf dem Bildschirm dargestellt werden müssen. Dies sind die Subpixel des Bildschirms.

Wie funktioniert die Subpixel-Ansteuerung bei Displays? Worin besteht der Unterschied zwischen OLED und LCD? Welche Erfahrungen hat Apple in diesem Bereich gesammelt? Darauf gehe ich im Detail ein.

Subpixel-Rendering

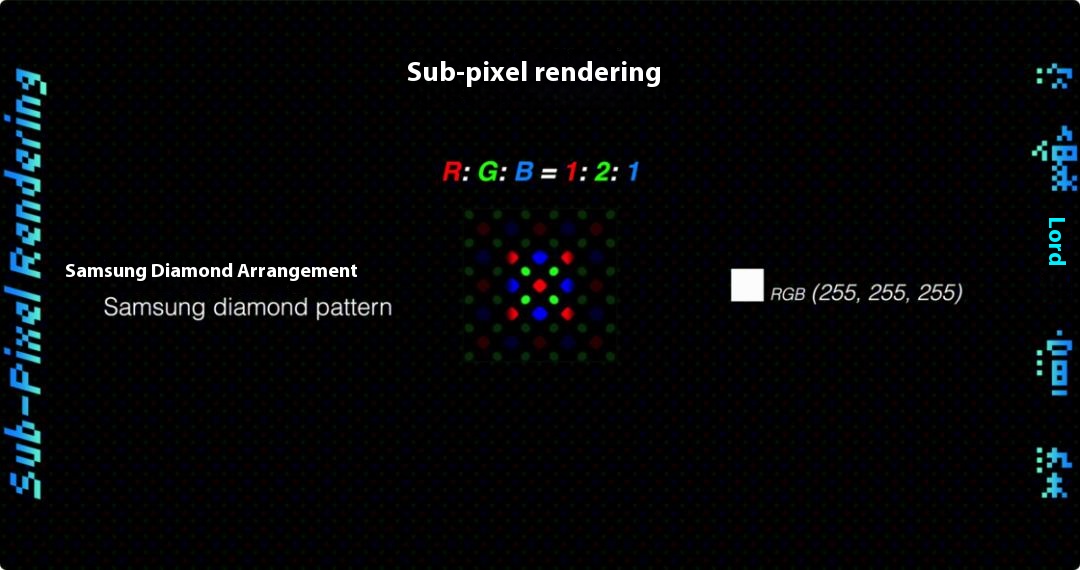

Zunächst eine kurze Erklärung der physikalischen Grundlagen. OLED-Pixel sind nicht im RGB-Farbverhältnis 1:1:1 angeordnet. Im Gegensatz zur herkömmlichen Diamantanordnung sind die roten und blauen Pixel jeweils nur halb so groß. Um beispielsweise einen weißen Punkt darzustellen, reicht es unter Umständen nicht aus, nur die drei RGB-Pixel zu beleuchten. Um Farbe und Form bestmöglich wiederherzustellen, müssen zusätzliche Pixel von den Randbereichen verwendet werden. Dies ist der Subpixel-Rendering-Algorithmus.

Wenn es gut umgesetzt ist, werden Sie den systembedingten Nachteil von OLED-Displays – das Fehlen roter und blauer Pixel – nicht bemerken. Ist es hingegen nicht gut umgesetzt, wirkt das Bild unscharf oder pixelig und ist nicht scharf genug. Daher zählt diese Funktion zu jenen, bei denen eine gute Umsetzung den Nachteil umso weniger spürbar macht.

Was Sie vielleicht nicht wissen: Obwohl LCD eine Standard-RGB-Anordnung verwendet, benötigt es ähnliche Mittel, um Kurven oder abgerundete Ecken zu glätten, wie z. B. ClearType und Integer-Skalierung unter Windows und HIDPI unter Mac, die alle ähnliche Probleme lösen.

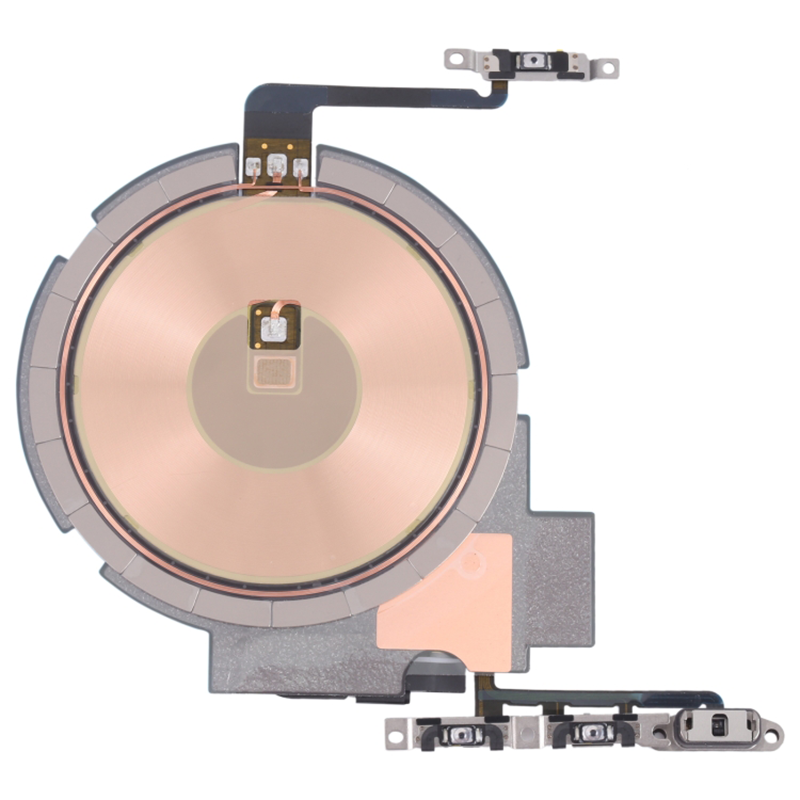

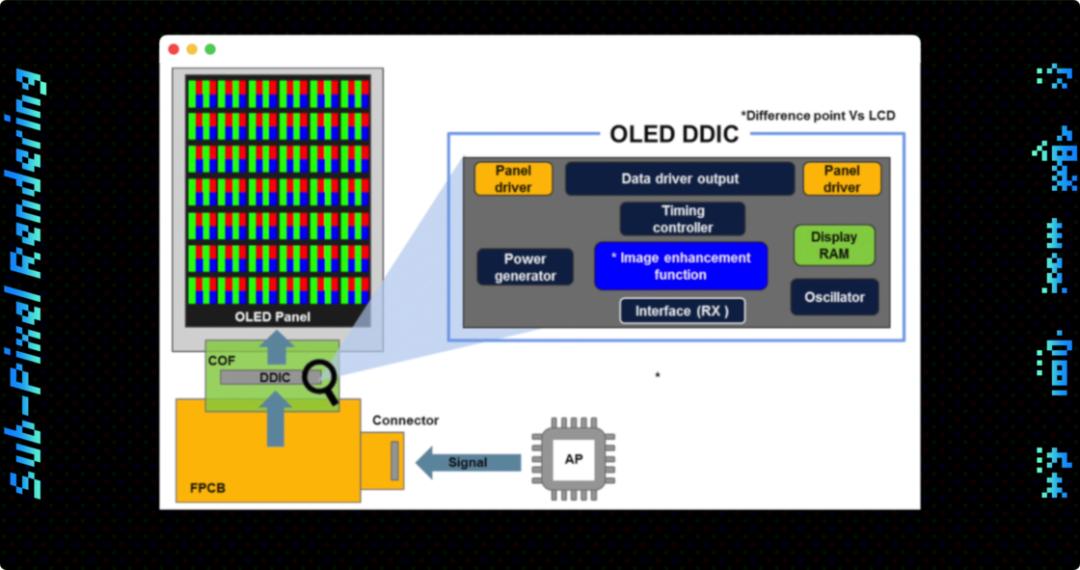

Diese Funktionen lassen sich per Software an verschiedene Displays anpassen, doch aufgrund der strengeren Stromsparbestimmungen bei Mobilgeräten müssen ähnliche Algorithmen in Hardware implementiert werden. Diese Hardware ist der Display-Chip, auch DDIC genannt. Er ist unscheinbar und hinter dem Display verborgen, aber man kann ihn üblicherweise in den Demontagevideos von Chef Lou Bin finden.

Dies ist auch der letzte Teil, der per Software gesteuert werden kann. Das Softwaresystem kann einzelne “Subpixel” nicht per Befehl ansteuern. Diese Funktion besitzt nur der DDIC. Egal, über welchen Inhalt oder Algorithmus Sie sprechen, Sie werden diesen Chip letztendlich nicht umgehen können. Ich werde ihn heute kurz vorstellen, und wir werden ihn in zukünftigen Videos vielleicht noch einmal erwähnen. Nach dieser kurzen Einführung kommen wir nun zum Wesentlichen.

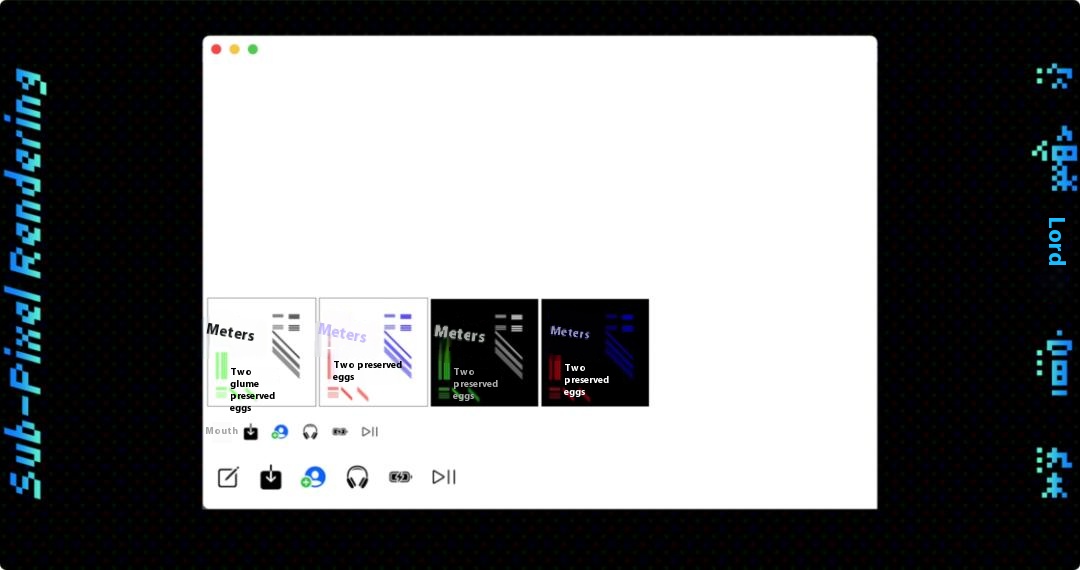

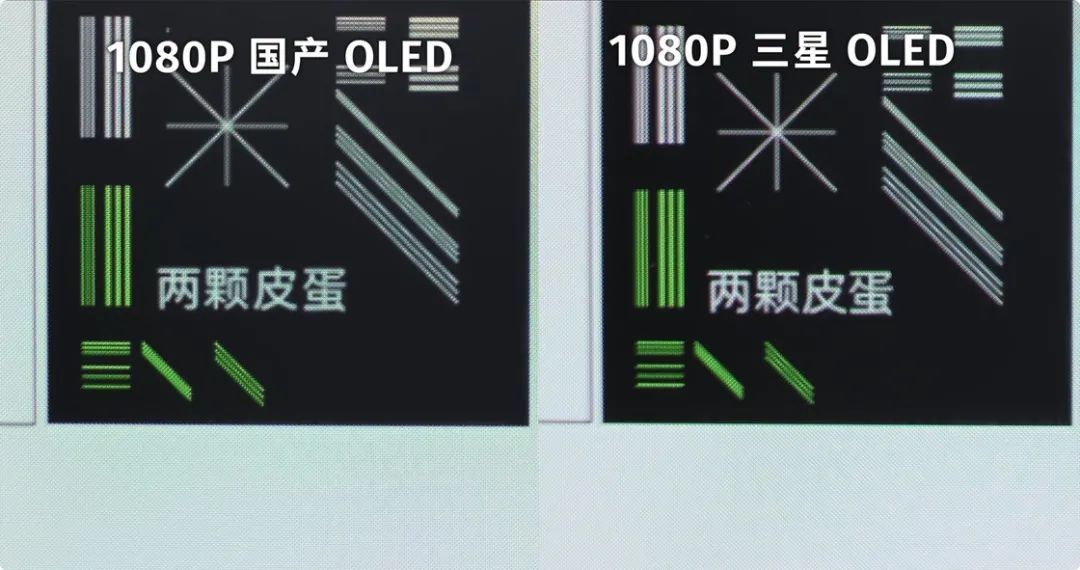

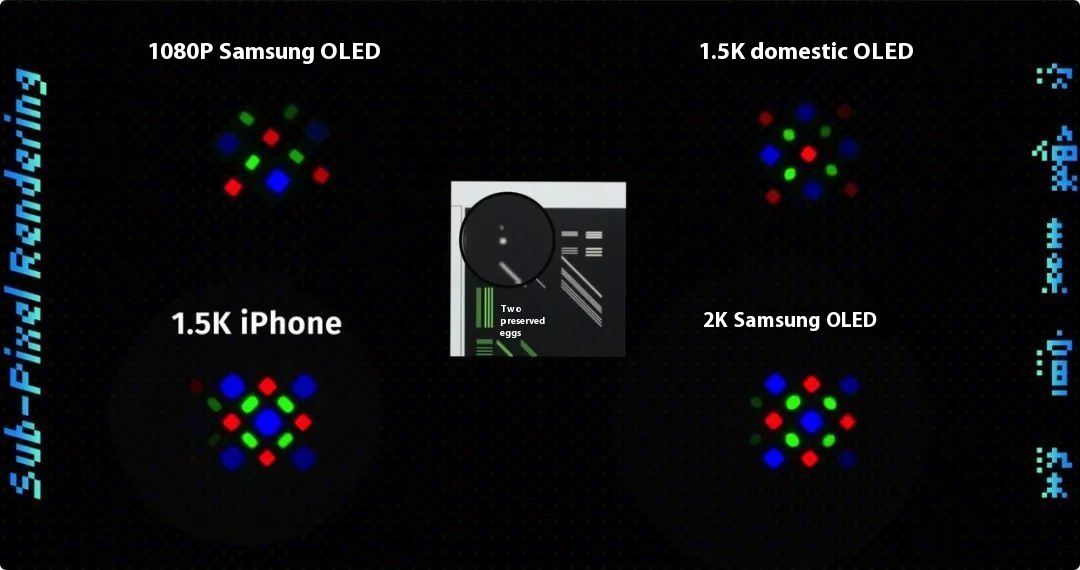

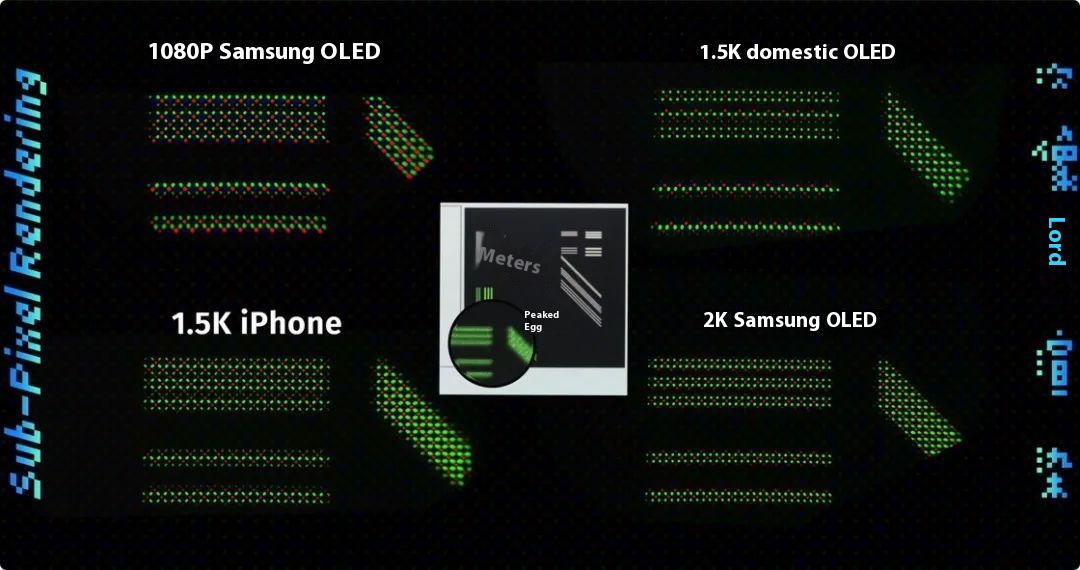

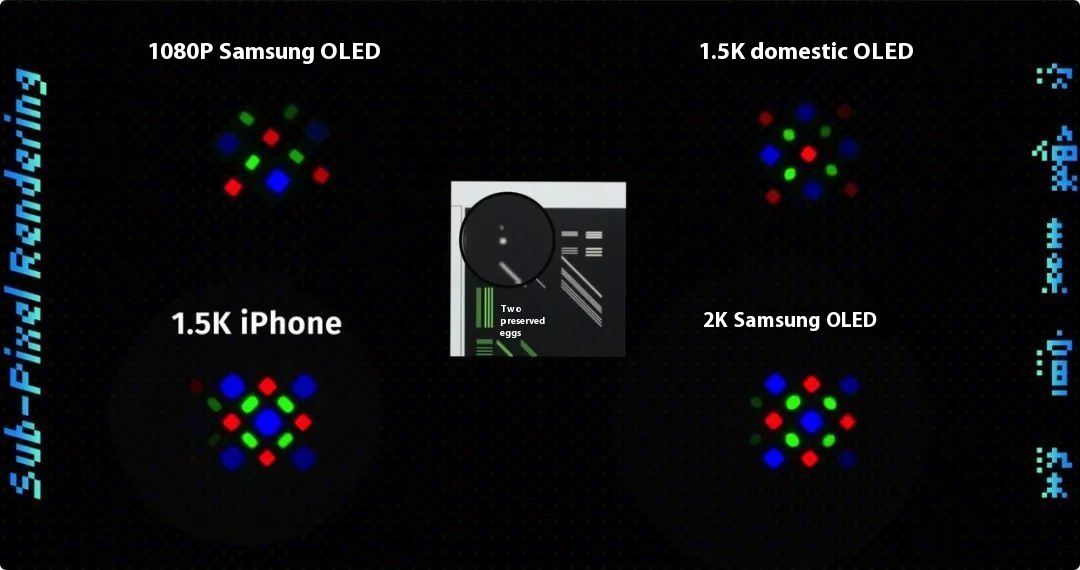

Um den Effekt des Subpixel-Renderings zu demonstrieren, habe ich meine jahrelang vernachlässigten HTML-Kenntnisse wieder aufgegriffen und eine Webseite zum Testen des Subpixel-Renderings erstellt. Mein Dank gilt Herrn Navis für seine Kreativität. Ich habe eine Webseite anstelle eines Bildes verwendet, da die Bildschirmauflösungen der einzelnen Geräte unterschiedlich sind. Manche Geräte bieten 1080p, andere 2K und wieder andere, wie beispielsweise Apple-Geräte, nicht standardmäßige Auflösungen. Um sicherzustellen, dass die Größe des Testmusters auf allen Geräten ähnlich ist, dieselbe Schriftart verwendet wird und es nicht durch Bildkomprimierung beeinträchtigt wird, ist es am zuverlässigsten, es per Code zu zeichnen. Obwohl das Bild relativ einfach aussieht, wurde der gewünschte Effekt erzielt.

Die Implementierung ist noch sehr unfertig, daher bitte ich die Entwickler um Nachsicht. Sie können den Anzeigeeffekt gerne auf Ihrem eigenen Mobiltelefon testen. Abschließend möchte ich noch einmal darauf hinweisen, dass der Subpixel-Rendering-Algorithmus von der DDIC-Chipfabrik und dem Bildschirmhersteller entwickelt wird. Der Unterschied liegt daher im Wesentlichen zwischen Samsung-Bildschirmen und Bildschirmen anderer Hersteller, LCD- und OLED-Bildschirmen sowie unterschiedlichen Auflösungen.

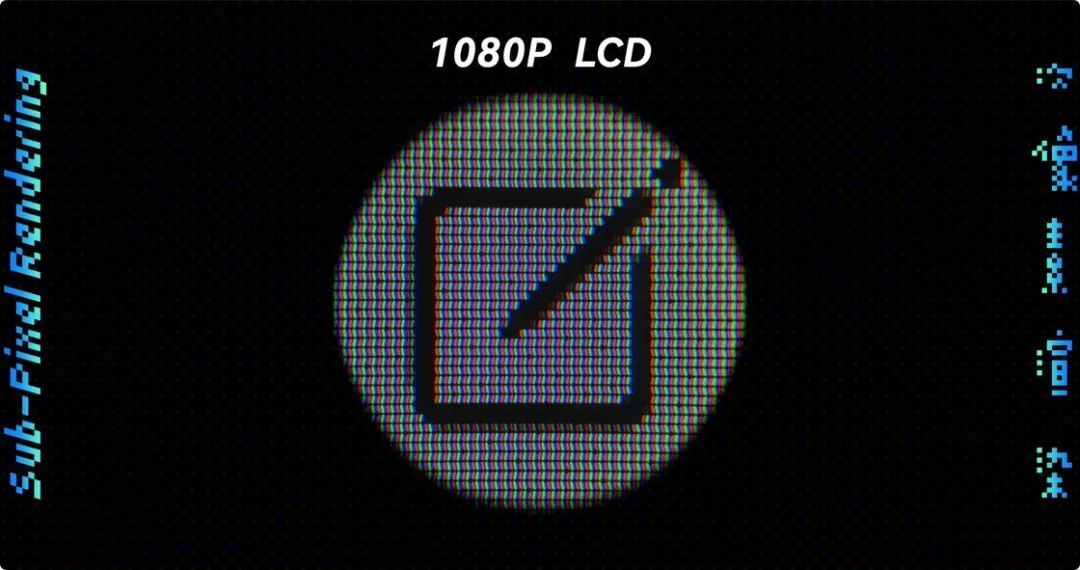

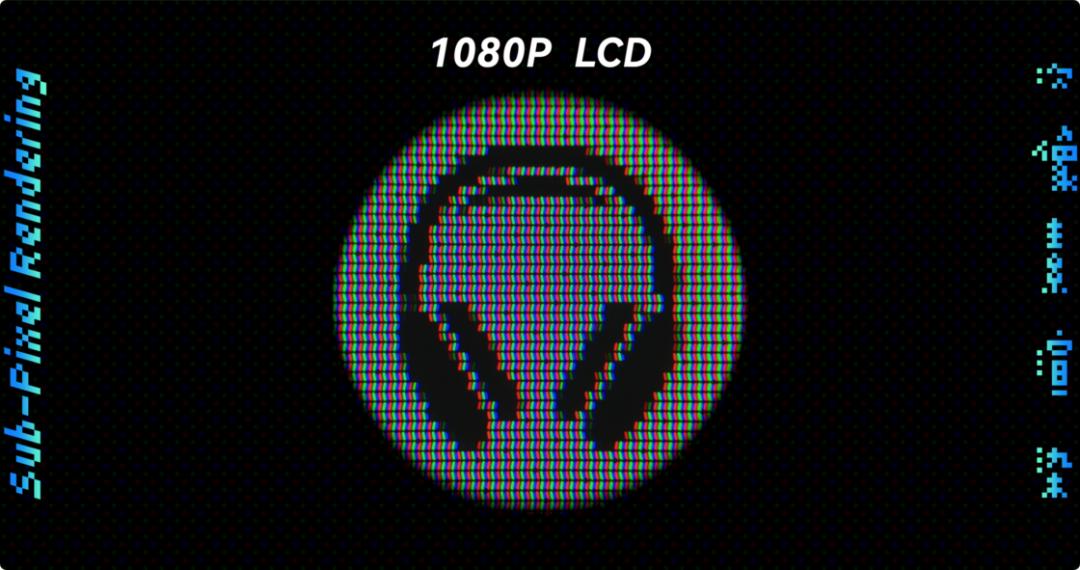

Machen Sie sich also bitte keine Gedanken darüber, welches Handymodell ich verwende, das ist für diesen Test völlig irrelevant. Schauen wir uns nun die Leistung des 1080p-LCD-Bildschirms an.

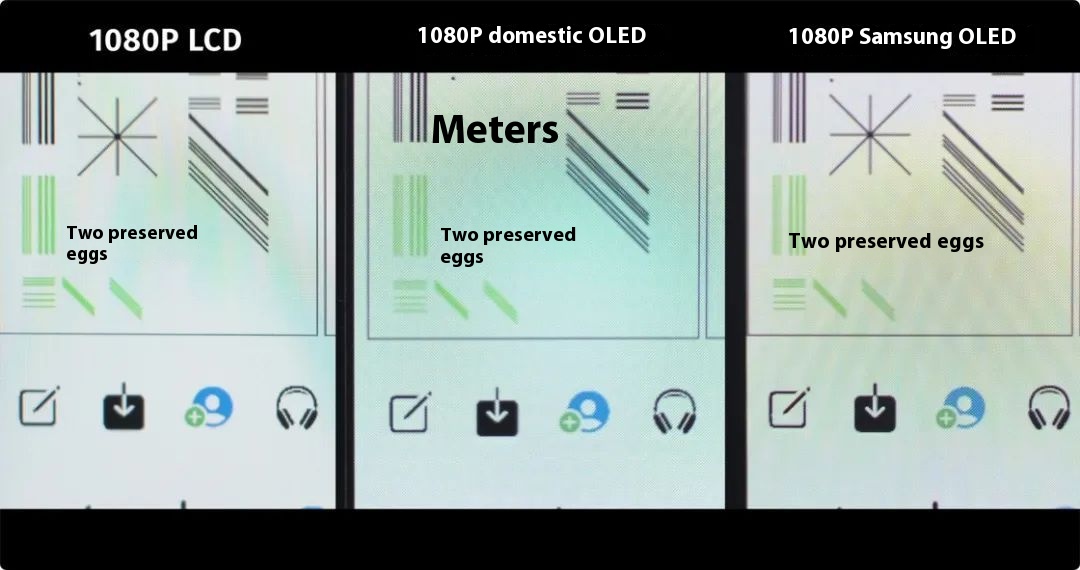

Betrachten wir zunächst den oberen Teil des Testbildes. Auf den ersten Blick ist die Darstellung sehr gut, der Text ist klar und scharf, und die geraden und diagonalen Linien im Abstand von 2 Einheiten lassen sich gut erkennen.

Schließlich handelt es sich um ein LCD-Display, daher ist der grundlegende Effekt definitiv kein Problem. Betrachtet man jedoch die Darstellung der Symbole genauer, so weist beispielsweise das Symbol für die neue Notiz ungleichmäßige Breiten links und rechts sowie oben und unten auf, und auch am Kopfbügel des Kopfhörersymbols sind deutlich gezackte Kanten zu erkennen.

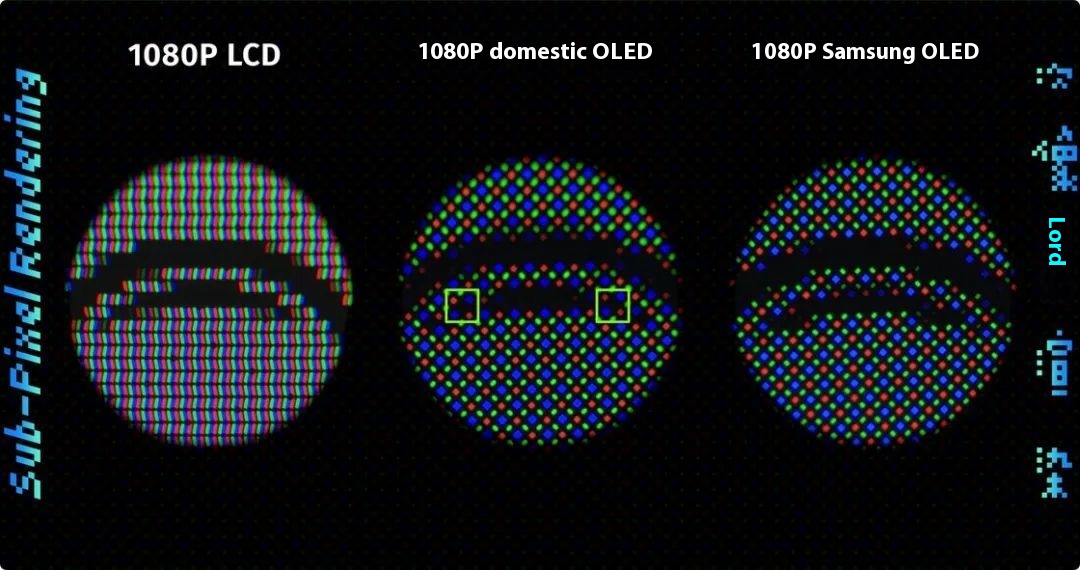

Wir verwenden ein Mikroskop, um die Subpixel-Darstellung genauer zu betrachten. Die halbhellen Pixel sind die Pixel, die für eine flüssigere Darstellung von den Seitenrändern ausgeliehen werden. LCDs verwenden jedoch ganze RGB-Pixel und können keine einzelnen Subpixel ausleihen. Das Haftnotiz-Symbol kann ohne Pixelausleihe vollständig dargestellt werden. Nach der Ausleihe ist die Breite der vier Seiten ungleichmäßig. Beim Kopfhörer-Symbol ist zu erkennen, dass die Bearbeitung nicht ausreichend ist, insbesondere an der Oberkante des Kopfbügels, die nicht ausgeliehen wurde, wodurch die Rundung nicht ganz glatt wirkt.

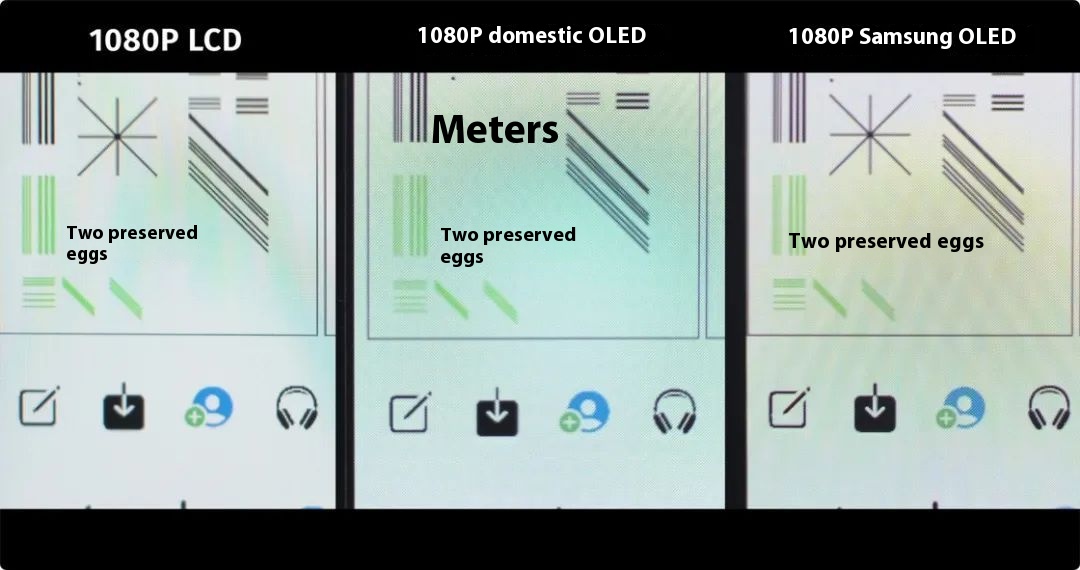

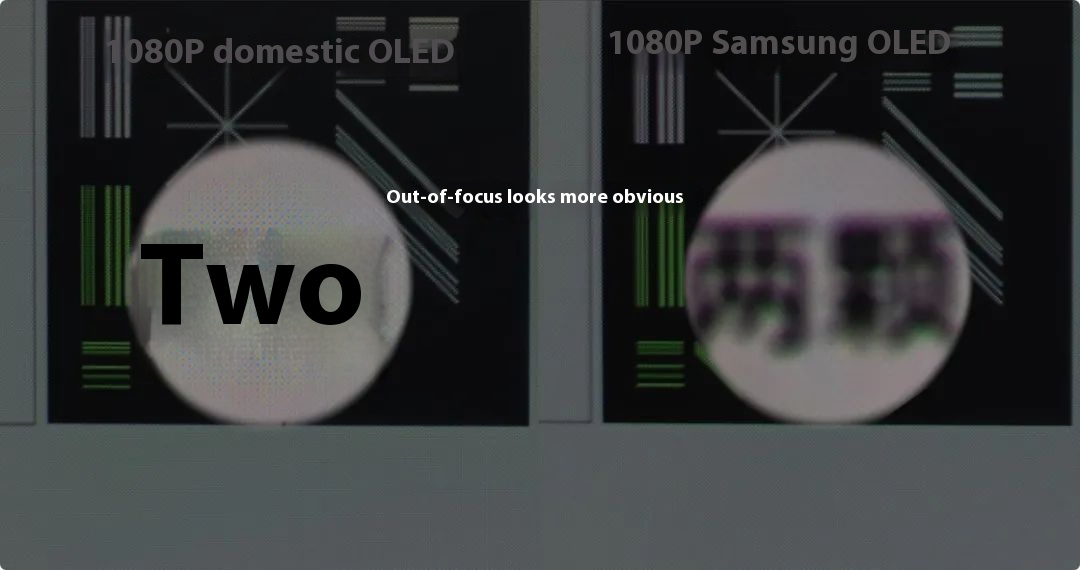

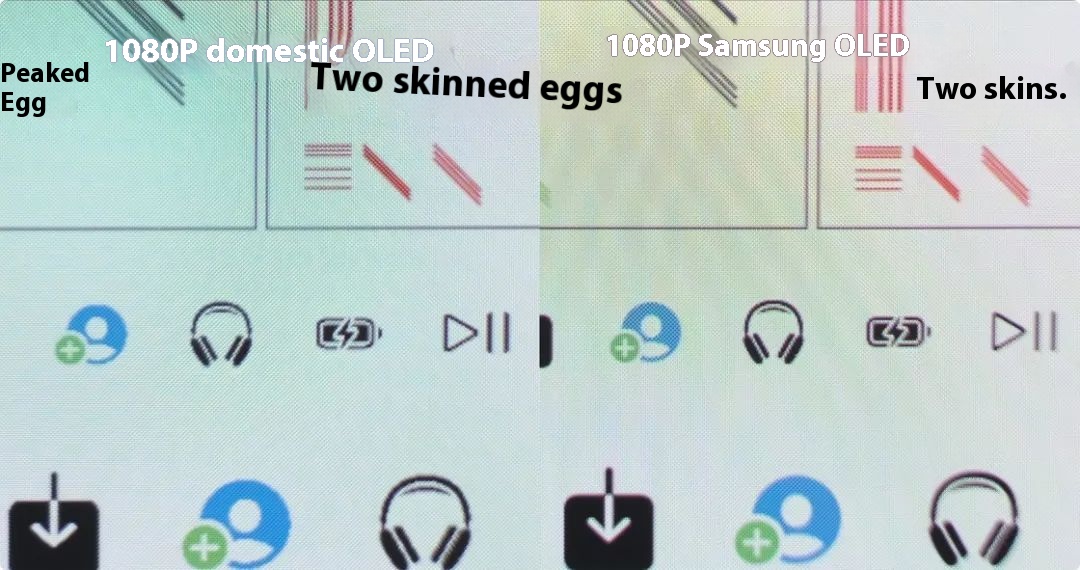

Anschließend vergleichen wir die Leistung von 1080p-OLED-Bildschirmen anhand dieser beiden Symbole und stellen den Bildschirm eines inländischen Herstellers dem Samsung-Bildschirm gegenüber, um die Unterschiede zu verdeutlichen. Zunächst fällt auf, dass das Haftnotiz-Symbol scheinbar das gleiche Problem ungleichmäßiger Breite in alle Richtungen aufweist. Hier scheint der inländische OLED-Bildschirm eine bessere Leistung zu erbringen, während die Kurve des Kopfhörer-Symbols auf dem Samsung OLED-Bildschirm fließender wirkt und eine bessere Darstellung als auf dem LCD-Bildschirm bietet.

Wir verglichen die Leistung unter einem Mikroskop. Als die inländischen Bildschirme Subpixel verwendeten, wurden an der oberen Kante mehrere weitere Pixelgruppen nach unten übernommen, und die roten Pixel waren sehr hell und auffällig und ragten zu weit in den schwarzen Bereich hinein, wodurch die Kontinuität der Kurve unterbrochen wurde.

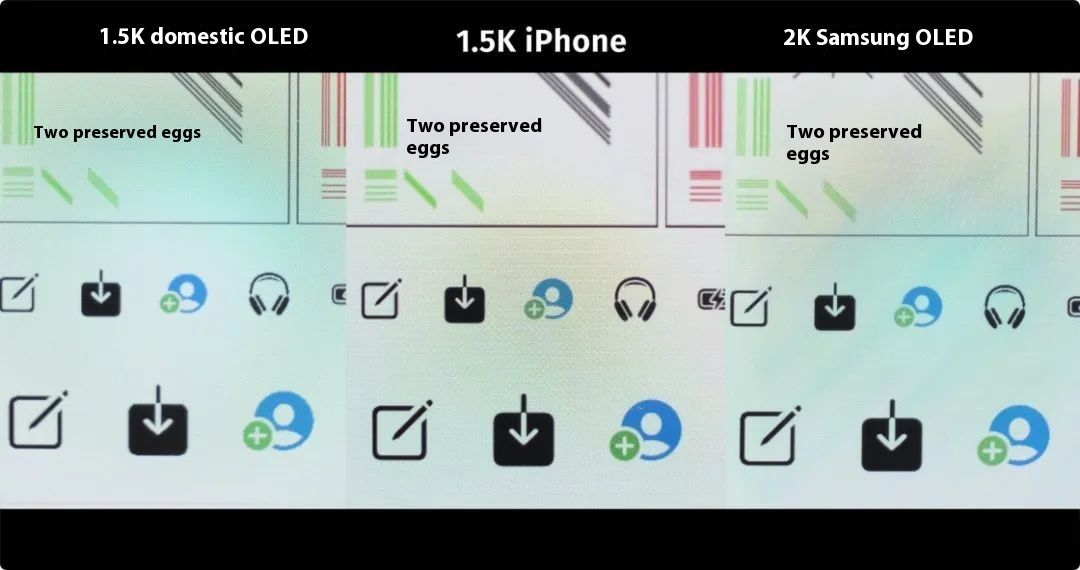

Und wenn wir uns das Testbild noch einmal ansehen und die großen Symbole in der unteren Reihe betrachten, hat der Samsung-Bildschirm immer noch einen Vorteil, aber der Bildschirm des einheimischen Herstellers macht bei der Textdarstellung das wieder wett, er wirkt schärfer und es gibt weniger Farbsäume an den Rändern, die durch das Ausleihen von Pixeln verursacht werden, sodass man sagen kann, dass es Vor- und Nachteile gibt.

Daraus lässt sich auch ableiten, dass der Unterschied zwischen OLED und LCD kaum wahrnehmbar ist, solange der Subpixel-Rendering-Algorithmus gut umgesetzt ist. In manchen Szenen ist OLED in puncto Bildglätte sogar besser als LCD, da die Subpixel präziser angesteuert werden können, um Kanten optimal auszufüllen. OLED ist nicht mehr das OLED von früher, genau wie CMOS anfangs qualitativ hinter CCD zurückblieb, CCD aber schließlich verdrängte. Die Zeiten haben sich wahrlich geändert.

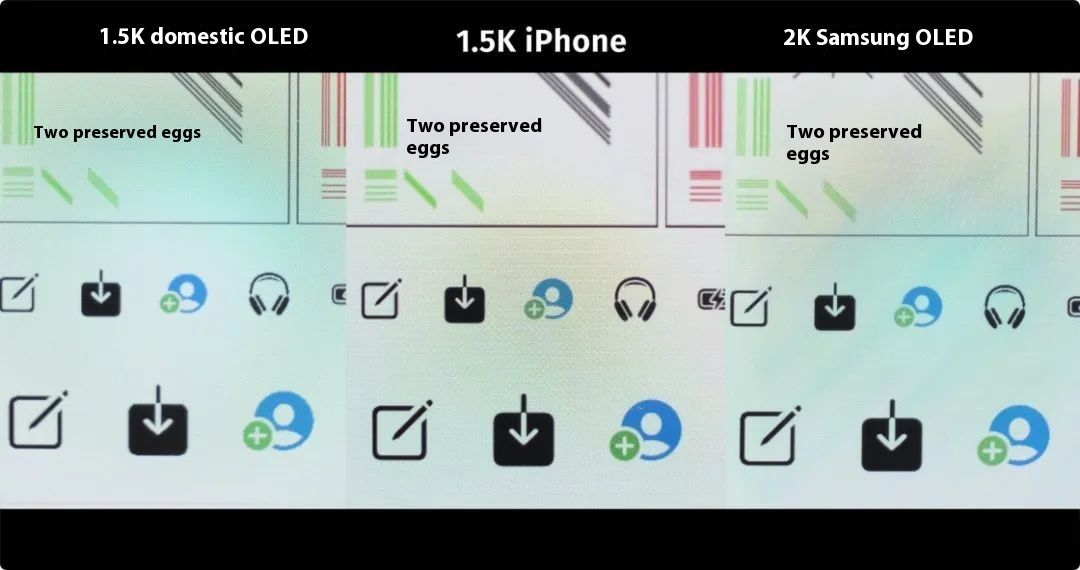

Betrachten wir nun den Vergleich der beiden 1,5K- und 2K-Bildschirme. Wir folgen dabei Redmis Angabe und rechnen das iPhone als 1,5K-Bildschirm. Zunächst einmal ist die Bildschärfe dieser drei Bildschirme deutlich besser als die eines 1080p-Bildschirms, insbesondere die Darstellung gerader Linien. Dank der höheren Pixeldichte hat der Subpixel-Rendering-Algorithmus mehr Spielraum, und selbst die Darstellung eines einzelnen Bildpunktes ist schärfer als bei 1080p.

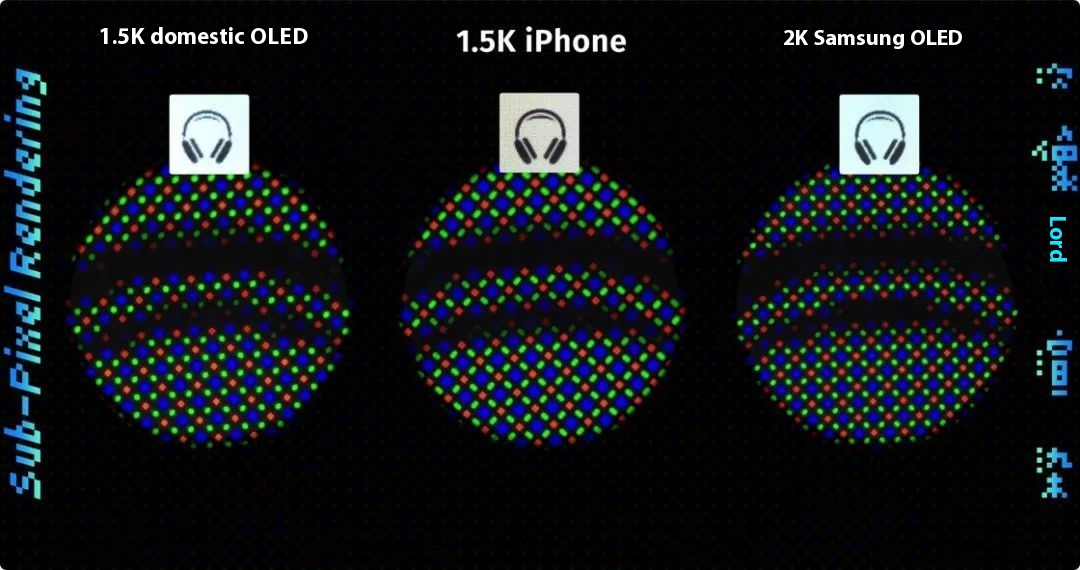

Bei der Betrachtung der Pixel mehrerer Bildschirme unter einem Mikroskop zeigt sich, dass 1,5K tatsächlich eine Wasserscheide darstellt und die dargestellten Punkte einem Quadrat angenähert sind. Betrachten wir die grünen Linien im Abstand von einer Einheit. Die Trennlinien zwischen ihnen sind ebenfalls deutlicher zu erkennen als beim 1080p-Bildschirm.

Wenn es schwerfällt, die drei Bildschirme zu unterscheiden, zeigt ein Blick auf die unten dargestellten Symboleffekte einen deutlichen Vorteil des iPhones. Das Haftnotizsymbol ist an allen vier Seiten gleich breit, und das Kopfhörersymbol wirkt extrem glatt und übertrifft damit sogar das 2K-Display mit seiner höheren Auflösung.

Beim Vergrößern des Bildes fällt auf, dass das iPhone mehr Subpixel verwendet, um die schwarzen Bereiche auszufüllen, wodurch der nicht leuchtende Bereich am kleinsten ist. Im Gegensatz zu herkömmlichen 1080p-Bildschirmen ist die Helligkeit der ausgefüllten Subpixel jedoch sehr gering und besser ausbalanciert, sodass die Krümmung für das bloße Auge weicher erscheint.

Tatsächlich lässt sich nach dieser Betrachtung eine Zusammenfassung ziehen. Bei einer Auflösung von 1080p weisen LCD-Bildschirme und Samsungs OLED-Displays jeweils ihre Vor- und Nachteile auf, sind aber beide etwas besser als die OLED-Bildschirme chinesischer Hersteller. Dies zeigt sich vor allem in der besseren Darstellung von Schriftarten auf LCD-Bildschirmen, während die Kurvendarstellung bei Samsungs OLED-Displays flüssiger ist. Im 1,5K-Bereich ist die Leistung chinesischer 1,5K-Displays, des iPhones und Samsungs 2K-Displays in etwa gleichwertig, doch hinsichtlich der flüssigen Darstellung von Symbolen hat das iPhone einen deutlichen Vorteil.

Die hier gezeigten Testdiagramme wurden natürlich unter extremen Bedingungen erstellt und sind speziell darauf ausgelegt, Probleme aufzudecken. Tatsächlich kann der Unterschied in der Bildschärfe bei der Nutzung eines Mobiltelefons weitaus größer sein als die Vor- und Nachteile des Algorithmus.

Man muss jedoch sagen, dass die rasante Entwicklung von Bildschirmen in den letzten zwei Jahren die Bildqualität enorm verbessert hat. Anfangs war Samsungs Diamond-Display zwar klar, doch die Vorteile einer guten Bildqualität gingen mit der Zeit verloren. Insbesondere im Video zum K50U habe ich gesagt, dass 1,5K-Bildschirme die 1080p-Bildschirme in Mittelklassegeräten ersetzen müssen. Die aktuellen Testergebnisse bestätigen dies. Außerdem bedeutet eine hohe Auflösung nicht zwangsläufig Schärfe. Subpixel-Rendering-Algorithmen können den Vorteil der Schärfe ausgleichen oder ihn sogar übertreffen.

Hier müssen wir eine Analogie zu einer Kamera heranziehen. Ein guter CMOS-Sensor kann nur die untere Grenze bestimmen. Nur mit guten Algorithmen und Optimierungen lässt sich die obere Grenze erhöhen. Ich vermute, manche werden das für übertrieben halten. Ich finde 1,5K angemessen. Im praktischen Gebrauch macht es ohnehin keinen Unterschied. Ich denke, die meisten sehen das genauso.

Tatsächlich scheint Apples Vorteil, wenn man nur die erste Phase des Burggrabens betrachtet und nur diese Schicht aushebt, nicht so offensichtlich zu sein. Aber Sie fragen sich vielleicht: Apple gibt jedes Jahr so viel Geld aus, um eine Bildschirmfabrik zu finden, die den Bildschirm exklusiv anfertigt – worin liegt dann die Stärke? Gibt es da noch ein Detail, das wir übersehen haben?

Fähigkeitsdemonstration

Betrachten wir nun Apples Bildschirm genauer. Ist Ihnen aufgefallen, dass die Pixel des iPhones größer, dichter und kleiner wirken, egal ob Sie ihn mit einem 1,5K-Bildschirm eines herkömmlichen Smartphones oder einem 2K-Bildschirm von Samsung vergleichen? Tatsächlich hat der iPhone-Bildschirm die größten Pixel, unabhängig davon, welches OLED-Display man vergleicht. Der Fachbegriff dafür ist das “Aperturverhältnis” des Pixels.

Die Erhöhung des Blendenöffnungsverhältnisses bietet viele Vorteile. Beispielsweise ist bei gleicher Spannung die Helligkeit von Pixeln mit einem größeren Blendenöffnungsverhältnis höher. Umgekehrt lässt sich durch die Erzielung derselben Helligkeit Energie sparen und die Lebensdauer des Bildschirms bis zu einem gewissen Grad verlängern.

Ich frage mich, ob einige Freunde jetzt fragen werden, warum die Erhöhung des Blendenverhältnisses so viele Vorteile bietet, dass selbst Samsungs eigener 2K-Bildschirm nicht nachgezogen hat, sondern nur Apple?

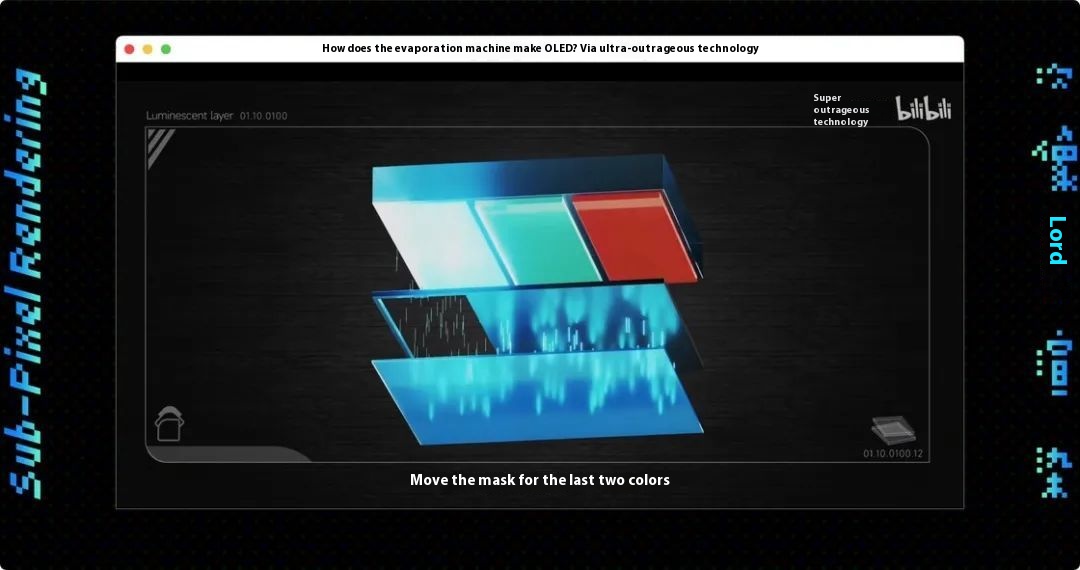

Ehrlich gesagt ist die Antwort ganz einfach: Es geht um Ausbeute und Kosten. Die Herstellung von OLED-Bildschirmen erfolgt durch Aufdampfen. Die drei RGB-Pixeltypen müssen dreimal aufgedampft werden. Bei jedem Aufdampfvorgang wird eine Maske verwendet. Das Pixel wird fixiert, sobald es durch die Maske auf das Substrat fällt. Um die Ausbeute zu gewährleisten und fehlerhafte Pixel zu minimieren, sollte die Maskenöffnung etwas größer als das Pixel sein.

Bei großem Pixelöffnungsverhältnis und hoher Pixeldichte ist die Größe der Maskenöffnung jedoch ein schwieriger Prozess. Ist sie zu klein, kann das Pixel nicht auf dem Substrat fixiert werden und wird fehlerhaft. Ist sie zu groß, fällt sie auf das benachbarte Pixel und die Farbe wird falsch dargestellt. Kurz gesagt, es handelt sich um ein branchenweites Problem. Ich weiß nicht, wie viel Zeit und Geld Apple in die Lösung dieses Problems investiert hat, aber das Ergebnis ist, dass Apples Bildschirme in einer komplett unabhängigen Produktionslinie bei Samsung gefertigt werden, die Helligkeit des iPhone-Bildschirms zum Branchenstandard geworden ist und der Stromverbrauch ebenfalls sehr gering ist. Hier spielt wohl die Macht des Geldes eine Rolle.

Schließlich ist Herr Cook ein Meister im Lieferkettenmanagement. Er kann nicht zulassen, dass die Kosten für den Bildschirm unbegrenzt steigen. Er muss sich etwas überlegt haben, um die Kosten zu senken. Was hat er sich überlegt? Die Antwort finden wir in einem Parameter, nämlich der Pixeldichte (“PPI”) des Bildschirms.

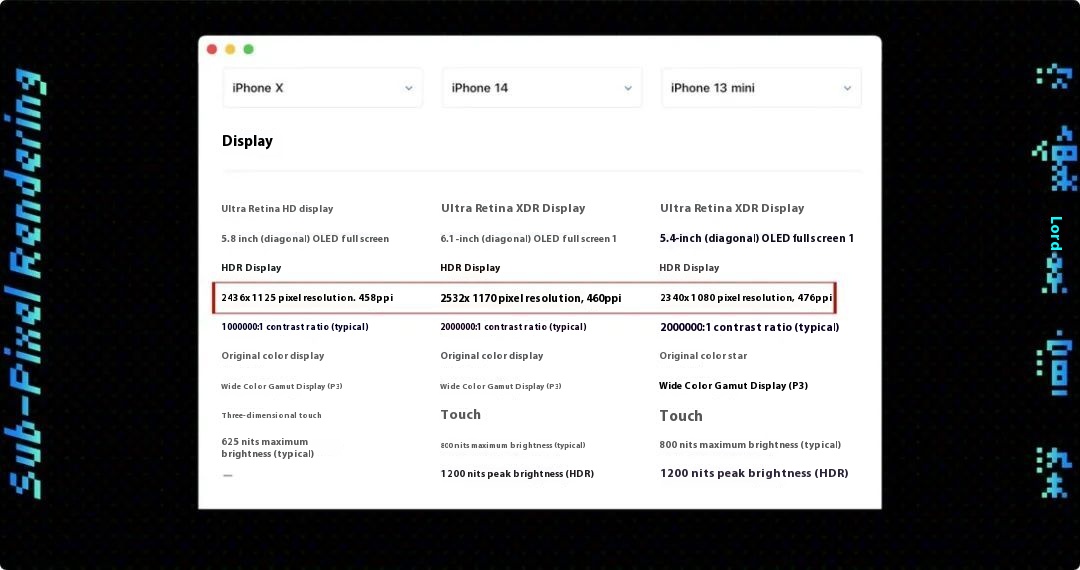

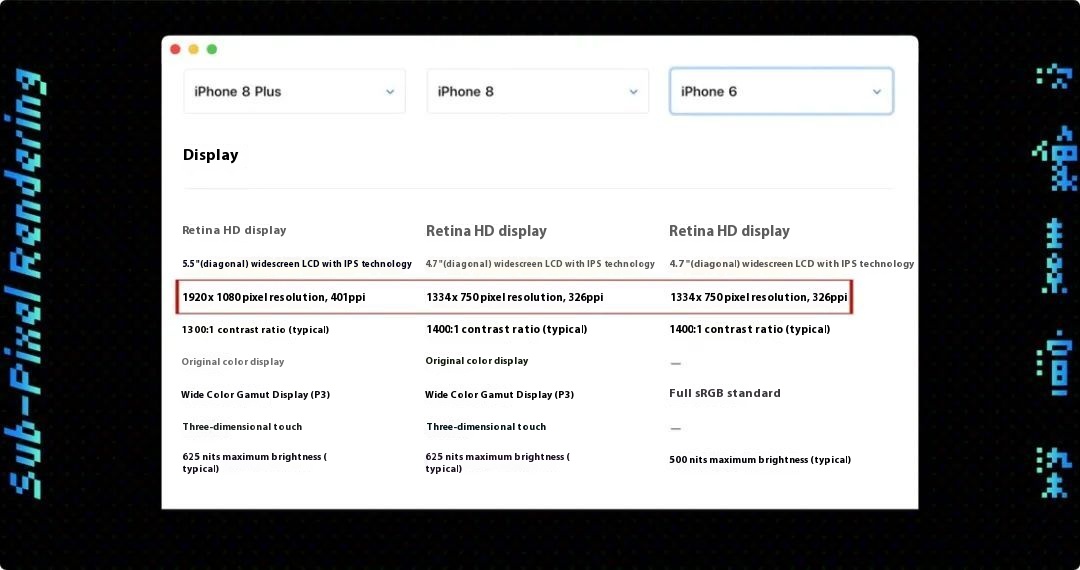

Apple ist tatsächlich ein ganz anderes Unternehmen. Ihre Produkte definieren sich durch die Bildschirmgröße, nicht wie bei anderen Herstellern durch die Auflösung. Die Auflösungen der Apple-Produkte sind zwar recht ungewöhnlich, aber bei genauer Betrachtung der Parameter stellt man fest, dass die Pixeldichte (PPI) gleich oder sehr ähnlich ist. Betrachtet man alle von Apple im letzten Jahrzehnt veröffentlichten Mobiltelefone, so tauchten LCD-Displays nach dem Upgrade auf Retina-Display nur noch in den Größen 326 und 401 auf. OLED-Displays gab es meines Wissens nur in drei Größen: 458, 460 und 476. Ich werde iPad und Mac nicht einzeln auflisten.

Aus Nutzersicht ist bei der Produktauswahl die Bildschirmgröße oft das ausschlaggebende Kriterium. Bildschirme unterschiedlicher Größe bieten eine vergleichbare Bildschärfe und Darstellungsqualität, und die Annahme, dass Apple-Bildschirme gut sind, ist fest im Bewusstsein der Nutzer verankert. Aus Kostensicht kann ein Bildschirm, solange die Pixeldichte (PPI) gleich ist, im Prinzip als ein einziger Bildschirm betrachtet werden, da er während der Produktion aus einem größeren Panel zugeschnitten wird.

Sogar Bildschirme verschiedener Generationen, wie das diesjährige 14 Plus und das letztjährige 13 Pro Max, sind identisch. Obwohl die Bildwiederholfrequenzen unterschiedlich sind, sind Größe und Pixeldichte (PPI) exakt gleich. Viele Produktionsprozesse lassen sich vollständig wiederverwenden, was die Kosten zusätzlich senkt.

Hierbei gibt es einen versteckten Kostenfaktor: die Forschungs- und Entwicklungskosten für das Subpixel-Rendering. Dieser Algorithmus ist eng mit der Pixeldichte (PPI) verknüpft, da Apples Bildschirme exklusiv angefertigt werden und der Algorithmus für das Subpixel-Rendering eigens entwickelt wurde. Bildschirme mit gleicher Pixeldichte verwenden denselben Algorithmus, wodurch das Rad nicht neu erfunden werden muss und gezieltere Optimierungseffekte erzielt werden können – quasi zwei Fliegen mit einer Klappe.

Das Wichtigste ist, dass die Kontrolle über Subpixel einer völlig neuen Welt gleichkommt. Denn dadurch wird auch die Kompensation von Einbrenneffekten ermöglicht. In diesem Jahr hat jeder bemerkt, dass sich das Always-on-Display (AOD) des iPhones deutlich von Android unterscheidet. Der Bildschirm schaltet sich nicht ab, sondern zeigt direkt den Sperrbildschirm an. Theoretisch ist dies natürlich anfälliger für Einbrenneffekte als das AOD von Android. Andererseits ist die Pixelgröße größer, was die Lebensdauer des Bildschirms verlängert. Zudem verfügt Apple über einen eigenen Kompensationsalgorithmus.

An dieser Stelle möchte ich Sie daran erinnern, dass die Kompensation des Einbrennens von OLED-Bildschirmen ein streng gehütetes Geheimnis ist. Ich kann Ihnen daher nur einige experimentelle Ergebnisse und Vermutungen mitteilen. Bitte betrachten Sie diese als Referenz. Freunde mit vertieften Forschungsergebnissen zu diesem Thema sind herzlich eingeladen, sich in den Kommentaren oder per privater Nachricht mit mir auszutauschen.

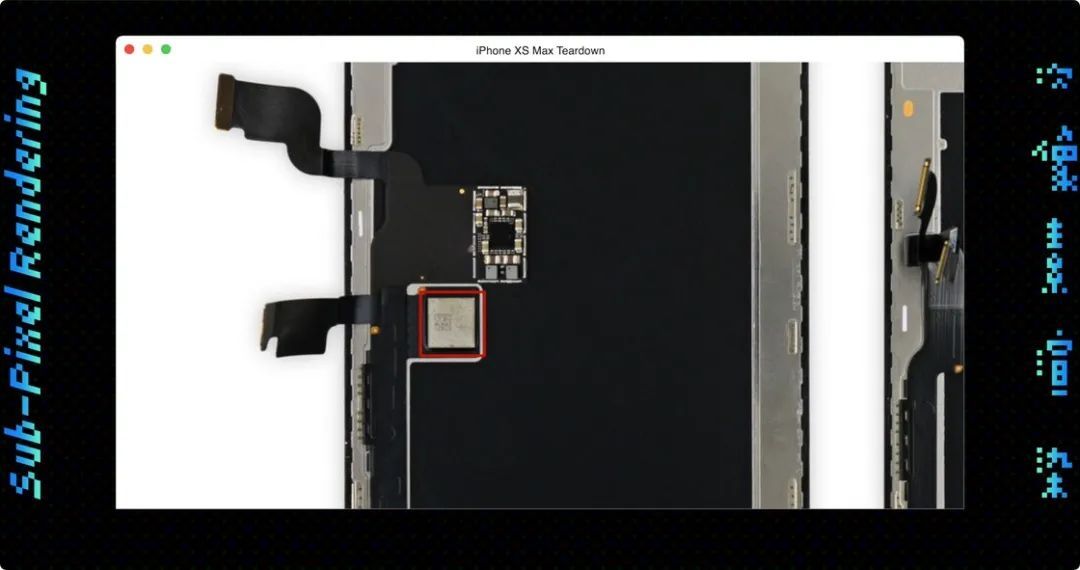

Vor drei Jahren führten wir zahlreiche Alterungstests mit dem iPhone XS Max durch und stellten fest, dass die Apple-Bildschirme eine deutlich längere Lebensdauer hatten als die von Android-Smartphones zu dieser Zeit. Einbrenneffekte traten kaum auf. Dies weckte unser großes Interesse. Nach einer technischen Analyse in Zusammenarbeit mit japanischen Bildschirmherstellern kamen wir zu dem Schluss, dass der von Apple im OLED-Bildschirm verbaute Flash-Speicherchip hierbei eine entscheidende Rolle spielen könnte.

Wir vermuteten, dass eine der Funktionen dieses Chips darin besteht, die Leuchtdauer jedes Subpixels zu speichern und die Helligkeit entsprechend der Lebensdauerkurve des jeweiligen Pixels anzupassen. Dies geschieht für jedes Subpixel, was etwa 8 Millionen Datenpunkten entspricht. Dadurch sind Einbrenneffekte auf dem Bildschirm – außer bei sehr starker Alterung – kaum sichtbar. Mit zunehmender Nutzungsdauer sinkt jedoch die Spitzenhelligkeit des Bildschirms, um der Helligkeit der am stärksten gealterten Pixel zu entsprechen.

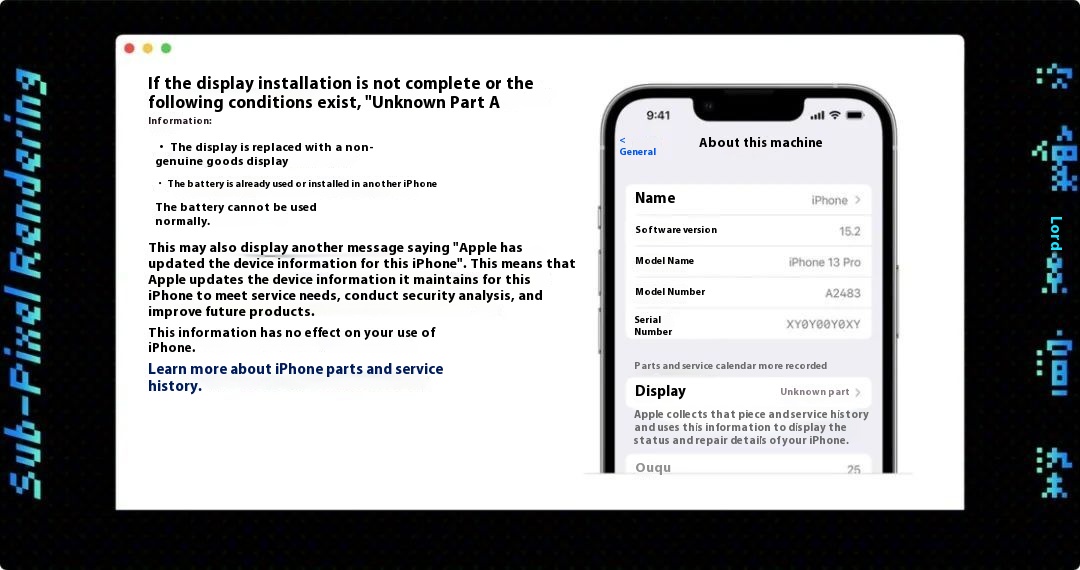

Dies könnte auch der Grund dafür sein, dass Apple 2019 mit der Bildschirmzertifizierung begonnen hat. Nur bei offiziellen Bildschirmen können diese Informationen erkannt und die Einbrennkompensationsfunktion normal aktiviert werden.

Ehrlich gesagt ist dieser Ansatz sehr clever und durchdacht. Er gewährleistet nicht nur die Kontrolle offizieller Reparaturen, sondern ermöglicht auch die Verknüpfung der Leuchtdauer mit dem Bildschirm. Bei ein und demselben Bildschirm ändert sich die Anzeigeleistung unabhängig von der Nutzungsdauer oder dem verwendeten Telefon nicht.

Wir vermuten, dass Apple dies umsetzen wird, da das iPhone im Alterungstest hervorragend abschneidet und Apple über die nötige Expertise verfügt, die für andere schwer zu erlernen ist: Flash-Speicherchips und DDICs müssen individuell angepasst werden, Subpixel-Rendering und Einbrennkompensationsalgorithmen sind eng miteinander verknüpft und müssen umfassend berücksichtigt werden, und die Alterungskurve jedes einzelnen Pixels muss im Voraus gemessen werden. Jeder dieser Punkte mag für andere Produkte eine enorme Herausforderung darstellen, doch Apple beherrscht all diese Aspekte und hat sie schließlich in eine einzigartige Funktion verwandelt: das Always-on-Display (AOD) von iPhone und Apple Watch.

Das ist die Stärke von Apples vertikaler Integration.

Ich muss jedoch hinzufügen, dass Samsungs eigene Mobiltelefone grundsätzlich dazu fähig wären, aber gemessen an den Ergebnissen unseres Alterungstests aus jenem Jahr ist ihre Leistung sehr durchschnittlich, und das aktuelle Always-on-Display ist nicht umfangreicher als bei anderen Android-Telefonen. Daher vermute ich, dass es noch ungelöste Schwierigkeiten gibt.

Zusammenfassen

Es ist wieder Zeit für eine Zusammenfassung. Nach der Analyse der Apple-Produkte habe ich oft den Eindruck, dass die Arbeit als Produktmanager bei Apple recht einfach sein könnte, da es nur wenige Einschränkungen gibt. Man muss sich lediglich auf die richtigen Dinge konzentrieren, und das technische Team ist stark genug, um die eigenen Ideen umzusetzen.

Sich auf die richtigen Dinge zu konzentrieren und die Lösungen detailliert und umfassend zu prüfen – ist das nicht der schwierigste Teil der Produktmanager-Position? Ohne die Einschränkungen externer Bedingungen wird das Können von Produktmanagern sogar noch stärker auf die Probe gestellt, da es keine Schnittstellen gibt.

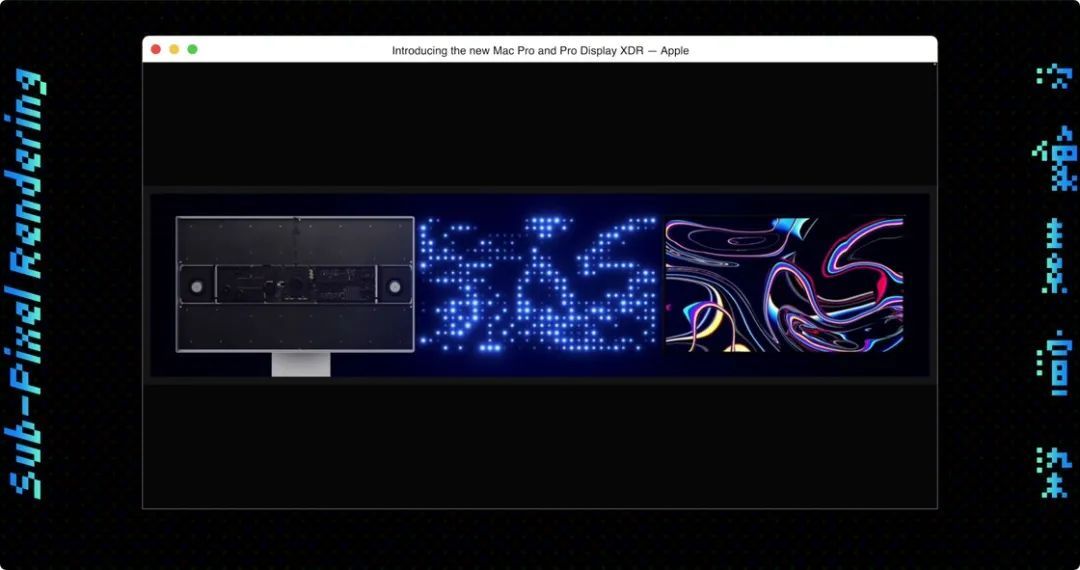

Ähnlich wie beim Subpixel-Rendering und den vielen verwandten Funktionen, die wir heute analysiert haben, sollte ich auch an Subpixel-Rendering und Einbrennschutz denken können. Die offizielle Bildschirmzertifizierung wird aber wahrscheinlich ignoriert werden. Wenn man genauer darüber nachdenkt, sind die Grundprinzipien von Subpixel-Rendering und Zonendimmung bei Mini-LED-Bildschirmen jedoch identisch. Dienen sie nicht alle dazu, weiche Kanten zu gewährleisten? Inwieweit ist der Zonendimmungsalgorithmus davon beeinflusst?

Je mehr ich mich mit Apple beschäftige, desto mehr merke ich, dass Apple für uns alle ein Lehrmeister ist. Oft bietet Apple die beste Lösung, die einen geradezu dazu anspornt, sie nachzuahmen. Manchmal ist es sogar schwierig, sie zu kopieren. Wie kann man andere dafür verspotten, dass sie nicht innovativ sind?

Nehmen wir beispielsweise den Anti-Einbrenn-Bildschirm. Aktuell wird überall nach Lösungen gesucht, doch das Problem liegt darin, dass Subpixel-Rendering-Algorithmen, die Anpassung der DDIC-Funktion und die Erforschung der Pixelalterung allesamt komplexe Herausforderungen darstellen. Selbst wenn man eine Idee hat, stößt man oft an Grenzen und kann nicht alles abdecken.

Der starke Aufstieg einheimischer Bildschirmhersteller hat die Branche jedoch tatsächlich verändert. Wie ich bereits im Video zum K50U erwähnte, sind die inländischen Anbieter sehr aufgeschlossen, und der technische Austausch während der Zusammenarbeit ist von großem Engagement geprägt. Sie sind bereit, gemeinsam die Bildqualität der Bildschirme zu verbessern.